החוכמה המקובלת אומרת, "אם אינך רוצה שישתמשו בנתונים שלך, בחר לבטל לחלוטין."

אנחנו אומרים, "אם הנתונים שלך נאספים בכל מקרה, הגיוני יותר להשפיע על אופן השימוש בהם."

זה לא: "האם לחברות יש את הנתונים שלי?" (הם כבר עושים זאת.)

השאלה האמיתית היא, "האם הנתונים שלי צריכים לעזור לבנות בינה מלאכותית טובה יותר עבור כולם?"

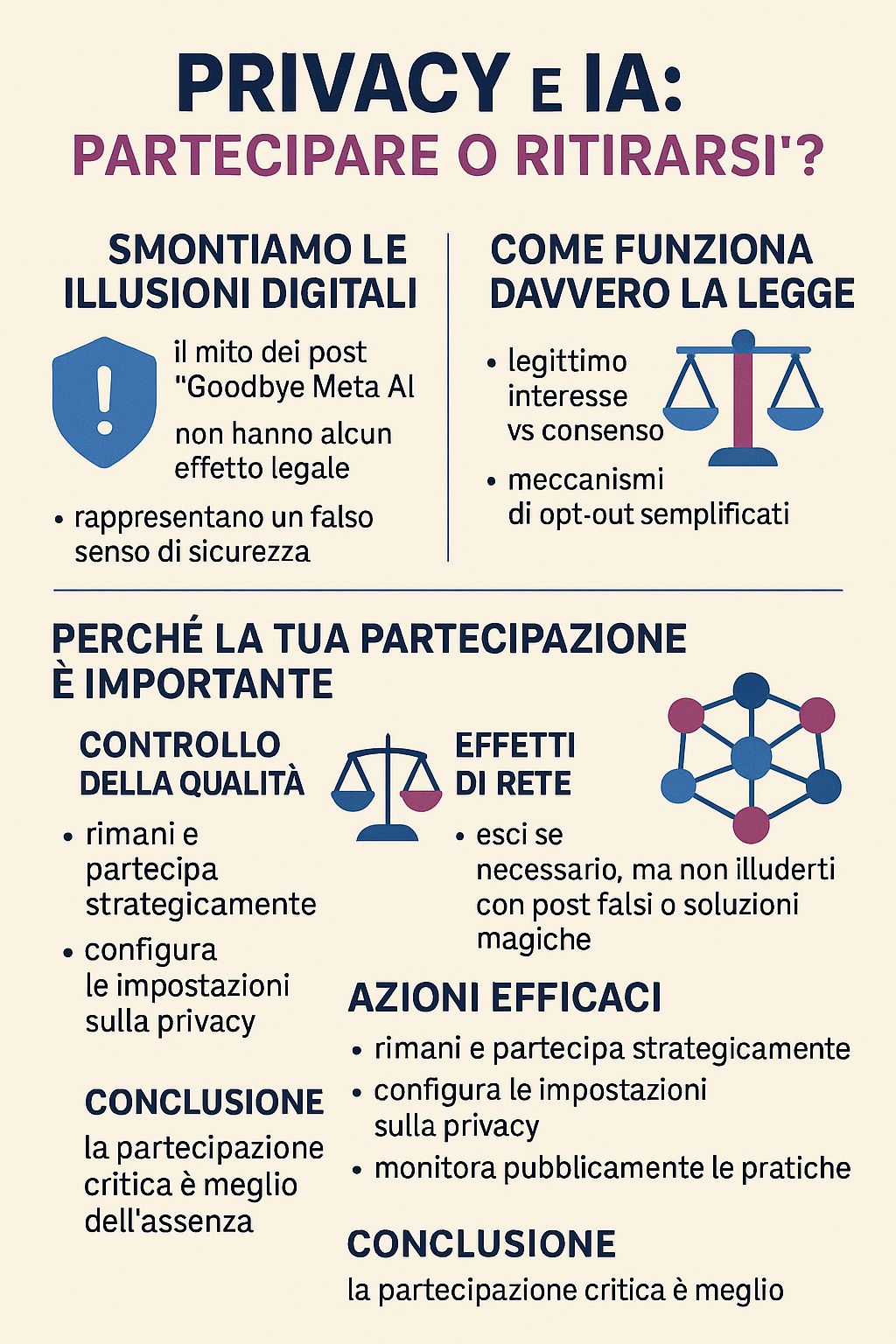

לפני שבונים ויכוח רציני, חשוב לפרק אשליה מסוכנת שמסתובבת ברשתות החברתיות: פוסטים ויראליים של "להתראות מטא בינה מלאכותית" שמבטיחים להגן על הנתונים שלכם פשוט על ידי שיתוף הודעה.

האמת הלא נוחה: הפוסטים האלה מזויפים לחלוטין ויכולים להפוך אתכם לפגיעים יותר .

כפי שמטא עצמה הסבירה, "שיתוף המסר 'להתראות מטא בינה מלאכותית' אינו מהווה צורה תקפה של התנגדות." פוסטים אלה:

ההצלחה הוויראלית של פוסטים אלה חושפת בעיה עמוקה יותר: אנו מעדיפים חשיבה פשוטה ומשאלת לב על פני החלטות מורכבות ומושכלות . שיתוף פוסט גורם לנו להרגיש מועצמים מבלי לדרוש את המאמץ להבין באמת כיצד פועלות זכויותינו הדיגיטליות.

אבל פרטיות לא מוגנת באמצעות ממים . היא מוגנת באמצעות ידע ופעולה מודעת.

החל מ-31 במאי 2025, מטה יישמה משטר חדש להכשרת בינה מלאכותית, תוך שימוש ב"אינטרס לגיטימי" כבסיס משפטי ולא בהסכמה. זו אינה פרצה, אלא כלי משפטי המסופק על ידי ה-GDPR.

אינטרס לגיטימי מאפשר לחברות לעבד נתונים ללא הסכמה מפורשת אם הן יכולות להוכיח שהאינטרסים שלהן אינם גוברים על זכויות המשתמש. זה יוצר אזור אפור שבו חברות "מתאימות את החוק" באמצעות הערכות פנימיות.

שימוש בנתונים שאינם אנונימיים טומן בחובו "סיכונים גבוהים של היפוך מודל, דליפות שינון ופגיעויות חילוץ". כוח החישוב הנדרש פירושו שרק גורמים בעלי יכולות גבוהות יכולים לנצל ביעילות את הנתונים הללו, וליצור אסימטריות מערכתיות בין אזרחים לתאגידים גדולים.

כעת, לאחר שהבהרנו את המציאות המשפטית והטכנית, בואו נבנה את הטיעון להשתתפות אסטרטגית.

כאשר אנשים בעלי ידע בוחרים להפסיק, בינה מלאכותית מאמנת את אלו שנשארים. אתם רוצים שמערכות בינה מלאכותית יסתמכו בעיקר על נתונים מאנשים אשר:

הטיות בבינה מלאכותית מתרחשות כאשר נתוני אימון אינם מייצגים. השתתפותך מסייעת להבטיח:

מערכות בינה מלאכותית משתפרות עם קנה המידה והגיוון:

אם אתם משתמשים בתכונות המופעלות על ידי בינה מלאכותית (חיפוש, תרגום, המלצות, כלי נגישות), השתתפותכם עוזרת לשפר אותן עבור כולם, כולל משתמשים עתידיים הזקוקים להן ביותר.

הפרטיות שלך לא משתנה באופן משמעותי בין הסכמה להשתתפות בבינה מלאכותית לבין הסכמה לביטול הסכמה. אותם נתונים כבר מפעילים:

ההבדל הוא האם נתונים אלה תורמים גם לשיפור הבינה המלאכותית עבור כולם או משרתים רק את האינטרסים המסחריים המיידיים של הפלטפורמה.

זו בדיוק הסיבה שאנשים אחראיים כמוך צריכים להשתתף. פרישה לא עוצרת את פיתוח הבינה המלאכותית, היא פשוט מסירה את קולך ממנו.

מערכות בינה מלאכותית יפותחו בכל מקרה. השאלה היא: עם או בלי תרומתם של אנשים שחושבים בצורה ביקורתית על נושאים אלה?

מובן. אבל קחו בחשבון את זה: האם הייתם מעדיפים שמערכות בינה מלאכותית ייבנו עם או בלי התשומות של אנשים שחולקים את הספקנות שלכם לגבי תאגידים גדולים?

חוסר האמון שלך הוא בדיוק הסיבה לכך שהשתתפותך הביקורתית חשובה.

בינה מלאכותית הופכת למציאות, בין אם אתם משתתפים ובין אם לאו.

הבחירה שלך אינה האם תיבנה בינה מלאכותית , אלא האם הבינה המלאכותית שתיבנה תשקף את הערכים והפרספקטיבות של אנשים שחושבים היטב על נושאים אלה.

ביטול הסכמה זה כמו אי הצבעה. זה לא עוצר את הבחירות, זה רק אומר שהתוצאה לא תתחשב בתרומתך.

בעולם שבו רק שחקנים בעלי יכולות חישוביות גבוהות יכולים לפרש ולנצל את הנתונים הללו ביעילות, לקול הביקורתי שלכם בהכשרה יכולה להיות השפעה רבה יותר מהיעדרכם.

הישארו והשתתפו באופן אסטרטגי אם:

ובינתיים:

אבל אל תטעו את עצמכם עם:

לביטול ההסכמה האישי שלך יש השפעה מינימלית על פרטיותך, אך לביטול ההסכמה יש השפעה ממשית על כולם.

בעולם שבו מערכות בינה מלאכותית יעצבו את זרימת המידע, ההחלטות והאינטראקציות בין אנשים לטכנולוגיה, השאלה אינה האם מערכות אלו צריכות להתקיים, אלא האם הן צריכות לכלול את נקודות המבט של אנשים מתחשבים וביקורתיים כמוך.

לפעמים, הפעולה הרדיקלית ביותר אינה לוותר. לעתים קרובות, הדבר הרדיקלי ביותר הוא להישאר ולוודא שקולך יישמע.

אֲנוֹנִימִי

זה לא עניין של אמון עיוור בחברות או התעלמות מדאגות לפרטיות. זה עניין של הכרה בכך שפרטיות אינה מוגנת באמצעות ממים , אלא באמצעות השתתפות אסטרטגית ומושכלת.

במערכת אקולוגית שבה אסימטריות הכוח הן עצומות, לקול הביקורתי שלך באימון בינה מלאכותית יכולה להיות השפעה גדולה יותר מהיעדרותך המחאתית.

לא משנה מה בחירתכם, בחרו מתוך מודעות, לא מתוך אשליות דיגיטליות.

פסקה של אהדה גם ל"נזירים של הפרטיות" - אותן נשמות טהורות שמאמינות שהן יכולות להימלט לחלוטין ממעקב דיגיטלי על ידי חיים לא מקוונים כמו נזירים טיבטים בשנת 2025.

התראת ספוילר: גם אם אתם גרים בבקתה מרוחקת בדולומיטים, הנתונים שלכם כבר נמצאים בכל מקום. רופא המשפחה שלכם משתמש במערכות דיגיטליות. הבנק שבו אתם שומרים את עצי ההסקה שלכם עוקב אחר כל עסקה. בסופרמרקט המקומי יש מצלמות ומערכות תשלום אלקטרוניות. אפילו הדוור שמביא לכם את החשבונות שלכם תורם למערכי נתונים לוגיסטיים שמזינים אלגוריתמים לאופטימיזציה.

נזיר דיגיטלי מוחלט בשנת 2025 פירושו למעשה נידוי עצמי מהחברה האזרחית . אפשר לוותר על אינסטגרם, אבל אי אפשר לוותר על שירותי בריאות, בנקאות, חינוך או תעסוקה בלי השלכות דרמטיות על איכות החיים.

ובזמן שאתם בונים את הצריף שלכם, העמיד בפני 5G, הנתונים שלכם ממשיכים להתקיים במאגרי המידע של בתי חולים, בנקים, חברות ביטוח, רשויות מקומיות וסוכנות המסים, ועדיין משמשים להכשרת מערכות שישפיעו על הדורות הבאים.

פרדוקס הנזיר: הבידוד המחאתי שלך לא מונע ממערכות בינה מלאכותית להיות מאומנות על נתונים מאנשים פחות בקיאים, אבל הוא כן מונע ממך להשפיע על התפתחותן בכיוונים אתיים יותר.

במהותו, כבשת את טוהר המוסריות הטהור של אלו הצופים בהיסטוריה מהיציע, בעוד שאחרים - פחות נאורים אך נוכחים יותר - כותבים את כללי המשחק.

לא משנה מה בחירתכם, בחרו מתוך מודעות, לא מתוך אשליות דיגיטליות.

מאמרים שצוטטו:

תובנות בנוגע ל-GDPR ואינטרס לגיטימי:

מקורות רשמיים:

לפעולה קונקרטית: אם אתם באירופה, בדקו את הליכי ביטול ההצטרפות הרשמיים עם רשות הגנת המידע האיטלקית. למידע כללי, עיינו בהגדרות הפרטיות ובתנאי השירות של הפלטפורמה שלכם. וזכרו: לאף פוסט ברשתות חברתיות אין ערך משפטי.